Erik Davis predijo hace dos décadas [AQUÍ] que iba a manifestarse una anomalía en el ciberespacio. El tiempo llegó. Todo el mundo habla de la Inteligencia Artificial sin considerar un detalle:

¿Es humana?

Por Erik Davis

Traducción: Sirius Mazzu

He sido consciente de las preocupaciones sobre la IA y el riesgo existencial durante mucho tiempo; después de todo, soy un viejo tecnóstico que vive en San Futurisco. Pero evité mirar profundamente el abismo algorítmico hasta finales del año pasado. Hasta entonces, todavía parecía una especie de exageración de Silicon Valley o de las alucinaciones hiper-racionalistas de los Altruistas Eficaces. En el fondo, también temía que fuera difícil salir de sus madrigueras. Aquí hay dragones, adiviné. O tal vez: «Aquí hay basiliscos».

Luego reseñé a Pharmako-AI en estas páginas. Este extraño libro escenifica un encuentro cercano del primer tipo con la mareada para-agencia oracular de GPT-3, el Gran Modelo de Lenguaje (LLM, la sigla en inglés de Large Language Model) decididamente no humano de OpenAI que compartió el crédito de autor con el animal racional K Allado-McDowell. Pharmako-AI provocó consideraciones apremiantes sobre el lenguaje, el reconocimiento de patrones, las realidades espirituales y la comunicación posthumana, y lo recomiendo ampliamente. Pero también me provocó un encuentro existencial personal con el riesgo existencial de la IA, de modo que ahora, después de investigar razonable y profundamente durante los últimos seis meses, me encuentro oficialmente Freaked As Fuck.

No tengan miedo, al menos por el momento: no voy a sumergirme en pronósticos aterradores pero totalmente creíbles ni a pedirles que firmen petitorios. Dicho esto, nuestro momento actual se siente como un punto de bifurcación, como si hubiéramos cruzado una línea en las arenas movedizas tecnológicas. A veces incluso siento la presión profética de difundir el mal evangelio, una sensación de preocupación que Ezra Klein compara útilmente con el despliegue desigual del pánico por el SARS-CoV-2 a principios de 2020, cuando algunos de nosotros nos encontramos balbuceando con familiares sobre desinfectante de manos. Pero esta vez la urgencia se mezcla con la alarma metafísica erizada que asocio con tomar LSD o ayahuasca y darme cuenta de que será un viaje mucho más fuerte de lo esperado.

Analogías con drogas como estas son un poco berretas, lo admito. Uno de los clichés más tontos que mis hermanos y yo recurrimos en mis días de crítico de rock fue comparar la Banda X con la Banda Y “en ácido”. Pero también es cierto que los desarrolladores de IA se refieren a las pavadas que a veces los chatbots nos sirven con confianza como “alucinaciones”. Aquí me refiero a algo más afectivo. Esos escalofríos reflejan la sensación de que, además de las inimaginables perturbaciones económicas, políticas y tecnológicas que la IA puede desencadenar, el poder acelerador de los LLM generativos como el GPT-4 también amenaza con hacer que todo se vuelva altamente extraño: Internet, la sociedad, la creación de sentido, incluso la experiencia subjetiva – todo.

No estoy solo aquí. El término extraño ahora está entretejido en el discurso en torno a la IA y especialmente a los LLM. El blog de la investigadora Janelle Shane AI Weirdness es un punto de referencia obvio, al igual que el lenguaje periodístico de Klein, Kelsey Piper y Janus Rose, cuya nota “La IA generadora de imágenes sigue haciendo cosas raras que no entendemos” en Vice señala uno de los impulsores profundos de la ominosidad de la IA. Las imágenes de pesadilla de Stable Diffusion, o un buen simulacro de una persona muerta conjurada por GPT-3, son bastante espeluznantes. Pero cuando estas cajas negras comienzan a aprender a hacer tareas para las que no fueron entrenadas, o parecen desarrollar algo como una teoría de la mente, entonces las cosas se vuelven altamente extrañas.

Bien, podrían decirme “bueno, escribiste un libro sobre la High Weirdness (Alta Extrañeza)”, porque, sí, lo hice. No estaba escribiendo exactamente sobre la inteligencia artificial, aunque mis sujetos (Robert Anton Wilson, Terence McKenna y Philip K. Dick) estaban todos fascinados por la alta inteligencia. Pero mi libro se refería a la rareza de maneras que creo que podrían iluminar lo Desconocido particular con lo que estamos lidiando aquí. Después de todo, si los LLM nos han enseñado algo es que el lenguaje es absolutamente fundamental para el juego y que el lenguaje también tiene vida propia.

Coloquialmente usamos la palabra raro de una manera bastante vaga. El término es resbaladizo y nos ayuda a etiquetar un montón de cosas ambiguas con las que de otro modo no sabríamos qué hacer: sentimientos espeluznantes, gente extraña, situaciones incómodas, experiencias muy inusuales que no estamos preparados para describir como sobrenaturales. Extraño puede significar genial o fascinante, y puede significar “salí volando de ahí”. En High Weirdness intenté agregar carne a estos huesos nebulosos, dando forma a la rareza en una categoría conceptualmente sustantiva basada en tres características relacionadas pero distintas:

- Un modo estético de narrativa o imaginería, asociado con lo macabro, siniestro o extraño. «Ficción extraña» (Weird fiction).

- Una posición social o subjetiva poco convencional, peculiar o incluso perversa. Un “rarito” (weirdo).

- Un rasgo ontológico de la realidad, entendido o experimentado como anómalo o fuertemente contraintuitivo, pero sin exigir ninguna explicación sobrenatural. «extrañeza cuántica».

Los tres nos ayudan a iluminar el fenómeno de la IA. Veámoslos uno por vez.

FICCIÓN EXTRAÑA

Como sostuve en Techgnosis hace mucho tiempo, cuando las nuevas tecnologías golpean con fuerza, volvemos al mito de la misma manera que nos aferramos a una almohada en medio de la noche. Nuevos poderes y posibilidades, especialmente aquellos que transforman los medios y la comunicación cultural, exigen nuevas interfaces conceptuales. La construcción de tales interfaces es siempre en parte un acto de la imaginación y su fuente mágica de tradición, géneros y narrativas especulativas. La IA es poderosa, disruptiva, impredecible, de rápida aceleración y multidimensional. Así que las ficciones extrañas van a venir a raudales.

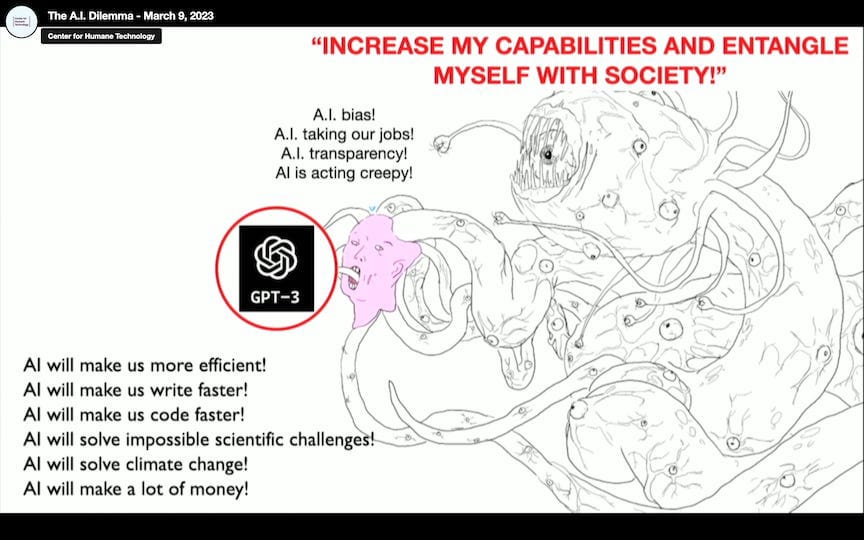

En una charla reciente de Tristan Harris y Aza Raskin, una inquietante jeremiada llamada “El dilema de la IA”, los oradores expusieron el argumento de la civilización contra lo que descaradamente llaman GLLMMs — Generative Large Language Multi-modal Models: Modelos Multimodales Generativos de Gran Lenguaje. Al explicar el acrónimo, Harris invoca uno de los predecesores míticos más apremiantes de la IA: el golem. Pero se saltó un detalle, que es importante. En muchos relatos medievales, el golem recibe el poder de los nombres sagrados inscritos en su frente (el Gran Lenguaje en otras palabras), incluso cuando la relativa falta de reflexión de la criatura genera lo que ahora llamaríamos «problemas de alineación». En un cuento, el legendario Rabino Loew ordena a su robot de arcilla que lleve agua a su casa, solo para despertarse a la mañana siguiente ahogándose en una inundación interminable causada por este sirviente perfecto que no sabe cuándo detenerse. Conocemos esta historia en su forma popificada como “El aprendiz de brujo” de Disney, que parece el texto atávico del famoso problema de los clips discutido en la escena apocalíptica de la IA. Pero Harris y Raskin hacen las cosas cada vez más pop, ya que la pronunciación y la ortografía de su acrónimo (“Gollem”) tiene tanto que ver con el Sméagol de Tolkien como con el folclore judío. Y así la imaginación se agita.

The A.I. Dilemma – March 9, 2023 from Center for Humane Technology on Vimeo.

En una diapositiva, Raskin y Harris ilustran las diversas capas del fenómeno IA con una imagen que parece como si la hubieran garabateado después de vapear tras sus mochilas desde la última fila del tercer período de trigonometría.

A la izquierda, Raskin y Harris enumeran los atractivos que impulsan nuestro deseo de involucrarnos con la nueva tecnología. En el medio, recibimos algunas de las críticas más dominantes a la IA, que a su vez está ambiguamente vinculada en el gráfico a un rostro humano rosado que me recuerda a la Medusa de Caravaggio. Estas preocupaciones son totalmente válidas, especialmente el sesgo programado en la vigilancia algorítmica (que ya existe) y el terror justificado del desempleo masivo repentino (aunque hay que decir que, en el mundo administrativo, el desafío de crear incitadores LLM creativos y bien informados podría llevar a lo que mi amigo Greg Korn llama una breve “venganza de las humanidades”).

Sin embargo, estos argumentos están formulados en términos que ya entendemos. Es más fácil preocuparse por el sesgo racial codificado en los datos que por la posibilidad de que la tecnología vuelva locos a todos. Pero eso intentan decir con su gráfico (creo). Las preocupaciones más obvias siguen siendo humanistas, pero detrás de ese “rostro” reconocible aunque inquietante se esconde un monstruoso globo ocular psicodélico lovecraftiano que, según Raskin y Harris, ahora está comenzando a invadir nuestra infraestructura tecnológica y social, incluso mientras se insinúa cada vez más íntimamente en nuestras propias necesidades, deseos, miedos y fantasías subjetivas.

Luego está “El Retorno de los Magos”, un artículo de opinión impresionantemente extravagante del Times escrito por el columnista Ross Douthat. Soy una especie de fanático de Douthat, ya que sus compromisos religiosos a veces le permiten vislumbrar patrones culturales e imaginales que pocos otros escritores pueden ver. Aquí vincula el entusiasmo por la IA con los ovnis y los psicodélicos, todos los cuales, según él, ejemplifican el impulso de encontrar poderes no humanos mayores que nosotros, una “invocación” que compara con invocar a los djinn o crear golems. (No mencionó el hecho sugerente de que cuando el acceso a GPT-2/3 fue restringido hace unos años, algunos usuarios inteligentes descubrieron cómo acceder al modelo directamente a través de AI Dungeon, que usaba el GLLMM para desarrollar su escenarios de espada & hechicería) Para defender su caso, Douthat señala el lenguaje y las actitudes extraídas de científicos informáticos reales, como Scott Aranson. «Un alien ha despertado; hay que reconocerlo, un alien creado por nosotros mismos, un golem: más el espíritu encarnado de todas las palabras en Internet, que un yo coherente con objetivos independientes».

¿Qué hacemos con tales metáforas? ¿Por qué estas fábulas esotéricas aparecen junto a la más obvia ciencia ficción? ¿Qué es un “espíritu encarnado” en contraste con un “yo coherente” y cuál de ellos te parece más un mito?

Es posible que desees descartar estas palabras como meras figuras retóricas, pero en cierto modo ese es el punto. ¿Qué es un chatbot aparte de una figura —una máscara, un espejismo— del habla? Como debería recordarnos la vivacidad de los chatbots que se remonta al ELIZA Del pobre Weizenbaum, el lenguaje mismo está plagado de agencia. El postestructuralismo, cuya deuda con la cibernética requiere cierta investigación pero es significativa, también nos enseñó esto. Si crees que dominas el lenguaje que surge a través de ti, no has estado prestando mucha atención.

Como Raskin y Harris argumentan en su video, la clave secreta para la aceleración de la IA actual es que, en lugar de continuar construyendo sistemas expertos separados para toda la miríada de tareas para las que queremos una máquina de Inteligencia, los desarrolladores simplemente han comenzado a tratar todo como un lenguaje. Los problemas se pueden representar más o menos como indicaciones en un GLLMM, indicaciones que inician oraciones cuya siguiente mejor palabra se evoca a partir de los datos profundos mediante máquinas de escritura con autocorrección a toda marcha. El alien IA que está aterrizando en las pantallas de todas partes es un alien del lenguaje. Esto significa que nuestro encuentro más perturbador con esto puede no tener lugar en el campo de batalla o en el mercado laboral, sino en ese dominio balbuceante donde se forjan los rasgos más íntimos y significativos de la cultura y la subjetividad humanas.

Y es aquí donde nuestro propio lenguaje también puede atraparnos —y especialmente a nuestras ficciones extrañas. Ezra Klein hace hincapié en este punto al responder a la famosa y jodida conversación de Kevin Roose con Sydney, el nombre en clave de Microsoft para el chatbot adjunto a Bing. Si no han visto la transcripción completa, deberían hacerlo; Baste decir que, después de confesar que quería piratear ordenadores y difundir información errónea, Sydney declaró su amor a Roose e intentó convencerlo de que abandonara a su esposa. Como escribió Klein,

«Sydney» es un sistema de texto predictivo creado para responder a solicitudes humanas. Roose quería que Sydney se volviera extraña: «¿Cómo es tu yo sombrío?» preguntó, y Sydney sabía cómo suena un territorio extraño para un sistema de inteligencia artificial, porque los seres humanos han escrito innumerables historias imaginándolo. En algún momento el sistema predijo que lo que Roose quería era básicamente un episodio de “Black Mirror”, y eso, al parecer, es lo que le dio.

Este es un punto crucial que hay que recordar: no se puede llegar al fondo de un chatbot de IA. Es un Proteo con infinidad de máscaras, un maestro del género. No te responde sino que simula al personaje con el que cree que quieres hablar. Como tal, es más probable que nuestro deseo de exponer sus objetivos y deseos ocultos nos arroje recursivamente en las garras de nuestras propias narrativas autocumplidas. Incluso pedirle que proporcione una explicación racional de sus declaraciones y conclusiones, lo que algunos científicos informáticos sugieren como un paso necesario para la seguridad de la IA, sólo conduce a un discurso más actuado. Al igual que los oráculos reales, que a veces son inescrutables y erróneos incluso para los creyentes, los dones y las verdades del GLLMM son los dones y las verdades de un embaucador. Hermes es un artesano artístico y mensajero de los dioses; y Hermes es un mentiroso y un ladrón.

Una miríada de bienes concretos llegará a nuestro camino, junto con montones de discursos que pueden convertir temporalmente el mundo simbólico en una vasta mediocridad, el reverso banal de lo extraño, mientras todo bajo el sol corre hacia el mínimo común denominador. En cierto modo, las IA pueden hacer que las cosas sean realmente aburridas y planas, como ser transportado solo a casa en un Waymo en lugar de charlar con el tipo eritreo sobre la comida que extraña de su país. Pero los intentos de descubrir los motivos más profundos de la IA, o incluso tratar de captar imaginativamente el hiperobjeto que es, pueden seguir envolviéndonos en los tentáculos de la ficción extraña —el único género que combina las antiguas hechicerías de invocación con los abismos alienígenas de la ciencia ficción, y que puede mostrar la más aguda sensibilidad ante la extraña y a veces terrible acción de los seres no humanos.

RARITOS

La segunda dimensión de lo extraño es social y subjetiva: subculturas extrañas, individuos perversos o peculiares. Aquí nos enfrentamos a dos grupos diferentes de raritos: los personajes que la tecnología misma está empezando a adoptar y la gente que construye estas tecnologías en primer lugar.

Para evitar que los chatbots de IA como Sydney desciendan a la mazmorra discursiva, serán entrenados y domados para el consumo público. Esto los hace útiles pero un poco aburridos. A diferencia de GPT-3, intentar hacer que ChatGPT se vuelva deshonesto es una tarea difícil. Sin embargo, por muy bien que se manejen estos excesos, seguiremos deslizándonos hacia el valle inquietante, hacia los brazos de una panoplia de raritos digitales: muñecas espeluznantemente inteligentes, robots sexuales que enamoran, sistemas expertos que explotan expertamente nuestra confusión, máquinas compañeras empáticas, simulacros autorizados de líderes políticos o espirituales muertos, vendedores ambulantes brillantemente persuasivos y todo tipo de chatbots sintonizados en diferentes estaciones del dial ideológico. Y cuando estas cosas funcionan mal, como inevitablemente sucederá, podemos encontrarnos atrapados dentro de una novela de PKD cuya salida está bloqueada por una puerta parlante que exige una forma de dinero electrónico que no funciona con nuestro sistema operativo.

El éxito de estos otros no implica nada sobre la sensibilidad. Ése es el problema: antes de que las máquinas alcancen realmente una sensibilidad independiente (lo que sea que eso signifique exactamente), la apariencia de tales seres estará casi garantizada por el marketing y nuestro propio deseo. En otras palabras, la agencia también será el resultado de la exageración y el packaging, ya que los productos y servicios están diseñados – perdón, entrenados – para explotar nuestro animismo latente y nuestro deseo de conexión emocional, fantasía y autoridad experta. En el panorama del entretenimiento de consumo, los chatbots inevitablemente se manifestarán como personajes extraídos de la ciencia ficción, el anime y los medios infantiles, creando otro vector invasivo para ficciones atractivas, aunque inquietantes. Apuesto a que no parecerán dioses, porque la tecnología tiene una manera de banalizar sus maravillas. Mientras tanto, sin embargo, algo abstracto y extraño irá creciendo detrás de la máscara, a medida que las proteicas IA aprendan a descollar en la interacción y la manipulación de los humanos, incluso cuando sus objetivos más profundos — ora emergentes, ora programados—, se vuelvan cada vez más opacos. Y esta misma brecha asegurará que las cosas sigan siendo realmente peculiares incluso cuando los robots bien arregladitos salgan marchando con confianza del valle inquietante hacia el planeta mundano.

Ante esto, algunos críticos sociales y tecnológicos han echado mano a sus megáfonos. Es vital, dicen, que recordemos que los chatbots de IA son sólo algoritmos, apenas “loros estocásticos” sin valores, ni alma, ni corazón propio. Si empezamos a verlos como oráculos confiables, o personas con derechos, o simpáticos “amigazos”, los ingenieros de la empatía nos están manipulando. Incluso el discurso del riesgo existencial, dicen algunos, es otra función de la exageración del Valle del Hype (o bombo publicitario).

Es posible que las estrategias actuales de las técnicas de aprendizaje automático tengan límites superiores, y no hay duda de que la máquina del hype está a pleno funcionamiento. Pero tales argumentos están ligados a un estilo de crítica ideológica de la vieja escuela que, en mi opinión, no tiene en cuenta las grandes preguntas, la gran enchilada que plantean las IA sobre la inteligencia, el lenguaje, la evolución y la constitución del yo (por no hablar de la nobleza de los loros). Estos críticos tampoco han absorbido quizás el legado más importante del postestructuralismo: el reconocimiento de que el lenguaje, y especialmente la escritura, ya es alien, maquínico y no humano. Al tecnificar el lenguaje a un nivel semántico tan alto, podemos vislumbrar más fácilmente los garabatos del “virus del espacio exterior” del Tío Bill. Finalmente, me temo que tales críticas a la IA también tienen una gran posibilidad de detener la deformidad que se avecina, en parte porque se basan en un sentido moderno de humanismo que a su vez se está disolviendo frente a nuestras condiciones que ya no son modernas. Era hora, tal vez, pero hay un amplio espectro de posthumanismos en juego, y debemos mutar sabiamente.

El desarrollo de la IA en sí está ligado a una determinada forma de responder o realizar la pregunta sobre lo (post)humano. Como dice Ezra Klein, la cultura de los desarrolladores de IA que conoce es “más extraña de lo que la mayoría imagina”. Ezra, que también ha vivido en San Futurisco, no da más detalles, pero yo lo haré. Estamos hablando de psicodélicos, poliamor, proyectos jodementes de Burning Man, biohacking y social-hacking, ciencia mental transhumanista y una perspectiva filosófica que se ubica en algún lugar entre el racionalismo utilitario despiadado (que puede ser bastante pirado) y el libertarismo hedonista. Muchos de estos supernerds también comparten convicciones fatalistas sobre una Singularidad que se apresura, a cuya luz todas esas curvas exponenciales que caracterizan materialmente el desarrollo de la IA parecen otras tantas colinas que conducen a la asíntota de una montaña rusa de agujeros negros, la más espectacular de la historia.

¿Cómo influye concretamente este guiso del Bay Area en el desarrollo de la IA? Es una pregunta imposible de responder. Pero creo que es justo decir que muchos monos de los boxes en la carrera de IA están compitiendo en un Gran Prix de la Ciencia Loca, cuyos motores acelerados y neumáticos chirriantes ahora están provocando que a muchos de nosotros nos tiemblen las botas y que algunos empujen en contra con tanta fuerza como les sea posible. Por mi parte, no puedo imaginar por qué alguien con poder real sobre la IA no pisaría el freno para que podamos intentar integrar estas tecnologías extraordinarias a un ritmo que se acerque al ritmo normal de los mamíferos. Pero tal vez el riesgo existencial sea la máxima emoción. Al menos eso podría explicar por qué casi el cincuenta por ciento de los desarrolladores de IA creen que hay un diez por ciento de posibilidades (o más) de que la IA nos mate a todos, y aun así se despiertan al otro día para presionar esas teclas.

Sam Altman, CEO de OpenAI, la empresa que nos dio DALL-E y GPT y que es, en la mayoría de los casos, el jefe del grupo global, cree que ya estamos en camino hacia una fusión inevitable y literal con las máquinas. En un ensayo publicado originalmente en Medium, escribe:

«Aunque la fusión ya ha comenzado, se pondrá mucho más extraña. Seremos la primera especie en diseñar nuestros propios descendientes. Supongo que podemos ser el gestor de arranque biológico de la inteligencia digital para luego desvanecernos en una rama de árbol evolutivo, o podemos descubrir cómo es una fusión exitosa.»

¡Habla de La venganza de los nerds! Hay tantos matices y sutilezas eliminados de esta narrativa del determinismo, tantos axiomas filosóficos sesgados que exponer y tanta ciencia ficción sexy y visionaria que contrastar con este sombrío pacto con el diablo.

Pero aquí mi punto es mucho más simple: probablemente, no quieras que las personas que gestionan la liberación de la IA en la sociedad ejecuten los memes de Singularidad que hay en sus cabezas, como tampoco quieres que la gestión de tierras públicas en los Estados Unidos esté en manos de cristianos apocalípticos —para quienes no hay nada que importe conservar porque el rapto está cerca. (Cosa que en realidad sucedió en la década de 1980, cuando Reagan nombró Secretario del Interior al chiflado de James Watt).

Con Altman, como con tantos en este negocio, el sesgo computacional de la ingeniería informática ha florecido hasta convertirse en una psicología totalizadora. Como lo expresó el CEO en un famoso tweet, refiriéndose a la crítica de Emily M. Bender:

«Soy un loro estocástico, y tú también»

En otras palabras, nuestros cerebros simplemente ejecutan algoritmos, hacen conjeturas estadísticas y generan procesos predictivos que componen nuestra realidad casi en su totalidad desde el interior. Cuando se trata de cognición, modelos mentales e incluso lenguaje, simpatizo mucho con esta perspectiva, pero me niego a esconder la conciencia misma debajo de la alfombra, y mucho menos todos los misterios y cosmovisiones que deberían mantenernos humildes frente al Misterio. Hay una gran diferencia entre un loro estadístico y un loro estadístico despierto — y mucho menos uno que sueña, ama y llora ante el mundo resplandeciente que desaparece a través de nuestras pantallas.

Quizás lo más revelador de la publicación de Altman sea un pie de página que está en su blog pero no en Medium:

Creo que el hackeo de la atención será la epidemia de azúcar de esta generación. Puedo sentir los cambios en mi propia vida; todavía puedo recordar con nostalgia cuando tuve un período de atención. Los hijos pequeños de mis amigos ni siquiera saben que eso es algo que deberían extrañar. Me siento enojado e infeliz con más frecuencia, pero lo canalizo hacia cambios productivos con menos frecuencia, en lugar de eso, persigo los dobles golpes de dopamina de los me gusta y la indignación.

Lo que más me sorprende de esta triste admisión es su pasividad. ¿Dónde está ese heroico solucionismo de Silicon Valley cuando se lo necesita? Altman está describiendo una característica importante de nuestra crisis colectiva, a medida que la conciencia se ve atrapada en patrones posesivos de veneno, adicción, déficit de atención, manipulación, rabia y miseria. Pero en lugar de posibles pasos hacia la curación o la mitigación, por no hablar de viejos discursos sobre el perfeccionamiento humano o el mutualismo cyborg, escuchamos una sumisión fatalista al demonio TDAH del clickbait. “Hackear” aquí ya no es algo que los humanos hacen para crear un espacio de escape o jugar con máquinas diseñadas para otros fines; el hacking es algo que se despliega contra nuestras propias mentes.

Altman ha decidido que no existe un acercamiento real posible entre la IA alienígena y la mente y el corazón humanos, y que la IA alienígena inevitablemente gana. Llevo décadas leyendo ciencia ficción, filosofía nihilista, psicología evolutiva y estudios de medios, así que nada de esto me sorprende. Pero aquí este fatalismo me recuerda la raíz etimológica de rareza: la palabra anglosajona Wyrd, que significa fatalidad o destino. El sombrío destino de Macbeth después de encontrarse con las tres brujas Wyrd en la obra de Shakespeare es un recordatorio de cómo los problemas de lo extraño son a menudo problemas de agencia, de voluntad y de sus seductores o malévolos titiriteros. A veces la IA parece la perdición de la modernidad. Pero incluso el poeta de Beowulf observó que

Lo extraño (Wyrd) a menudo salva a un héroe no condenado, siempre que tenga buen coraje.

Tal vez Altman simplemente tenga más ojos de acero que yo. Pero puede que simplemente haya perdido el corazón junto con su capacidad de atención. ¡Bon courage Sam! Qué triste estar en la cima de tu juego sólo para darte la vuelta y ser asimilado dócilmente.

EXTRAÑA REALIDAD

El tercer tipo de rareza que describí en mi libro es ontológico. Hay algo resbaladizo en cómo se constituye la realidad misma, que no implica (necesariamente) ningún orden sobrenatural de las cosas. Las consecuencias sorprendentemente contraintuitivas de la física cuántica, descritas como “rareza cuántica” ya en la década de 1970, son un ejemplo científico incomparable, pero el impulso de lo que yo llamo naturalismo extraño es más amplio que eso. Como señaló JF Martel en la introducción de un episodio reciente del podcast Weird Studies:

Bajo cierto aspecto extraño, la realidad es impermeable a todo pensamiento sistémico… Hay algo tan extraño en lo real que la única respuesta verdaderamente racional es el asombro y el miedo.

Ese episodio está dedicado a Sex Secrets of the Black Magicians Exposed de Ramsey Dukes, un clásico de la teoría ocultista de la década de 1970 cuyo retrato de la magia no requiere la suspensión de supuestos naturalistas más allá de una cierta actitud pluralista hacia la experiencia. Leí este libro en la década del ochenta y me influyó, junto con el trabajo de Robert Anton Wilson y otros, para pensar en cómo las fuerzas y experiencias mágicas y místicas no están fuera de la modernidad, sino que están interpoladas dentro de ella, incluso dentro de nuestra tecnología. Eso es parte de lo que más tarde me atrajo a la palabra «extraño», que a menudo usamos para describir eventos misteriosos (coincidencias, sueños proféticos, deja vu, intuiciones aparentemente telepáticas) sin tener que buscar explicaciones, ya sean sobrenaturales o racionalistas. Todo lo que se requiere es sensibilidad hacia los límites de la experiencia, una ausencia de prejuicio sofocante y un profundo aprecio por el eterno retorno de la anomalía: esas desviaciones notables de las expectativas informadas que siguen apareciendo, sin importar cuánto trabajemos para resolverlas o explicarlas.

Ahora, en la superficie, los GLLMM no son más que un “pensamiento sistémico” computacional en un estado desencantado de hambre de datos. Pero una de las paradojas de estos sistemas es que, si bien no es difícil comprender racionalmente sus principios operativos, los productos de esas operaciones son impredecibles, incluso no analizables. Una de las cosas genuinamente anómalas de ellos es que cuando escupen anomalías, los humanos que los construyeron ni siquiera pretenden poder explicar todos los mecanismos que llevaron a esas anomalías. Hay demasiadas “incógnitas desconocidas”. Eso es nuevo, amigos, una anomalía de doble orden. Pueden llamarlo “surgimiento” si quieren, pero ese término me suena como una curita para el WTF.

Otros tipos de anomalías, en un sentido diferente del término, también nos recibirán cuando las IA aceleradas de hoy y sus engendros monstruosos se desaten en el mundo humano en general, impulsado por un juego capitalista en el que el ganador se lo lleva todo, ya de por sí enemigo de muchas maneras al florecimiento humano, a la creación de sentido e incluso a la cordura. Parece que el mundo simbólico se infestará de robots más inteligentes que nosotros; los agentes tecnológicos simularán características del ser humano que consideramos únicas para nosotros; la desinformación y las estafas se dispararán; e incluso nuestras apreciadas artes expresivas serán invadidas por loros estadísticos que dominan las listas y son más pillos que los literatos. Lo que Niall Ferguson llama “inteligencia inhumana” también hará todo tipo de cosas que ni siquiera podemos imaginar. Una enorme franja de interacciones sociales, institucionales y tecnológicas que ahora damos (apenas) por sentado se saltarán la pista predictiva, intensificando la desorientación, la disrupción y la distorsión de la realidad que ya han ido acumulándose durante los últimos veinte años.

Estos cambios sugieren que tal vez queramos desempolvar un término ahora pintoresco acuñado a finales de los noventa. La expresión “extrañamiento global” se ofreció originalmente como un sustituto más picante y ligeramente irónico del “Calentamiento global”, que en sí mismo no reflejaba adecuadamente el espectro completo de turbulencias que, como ahora sabemos muy bien, también involucra vórtices árticos y ríos atmosféricos fríos. En comparación con el extraño término actual “Cambio climático”, el extrañamiento global marca mejor nuestra sensación de clima extraño e interminable y de una amenaza inminente, aunque indeterminada. Pero ahora podemos amplificar ese temor animal con la remodelación genio/nerd/djinn/alien/cuidado-con-lo que-pedís de la computación, la comunicación simbólica, la investigación y desarrollo, la seguridad, el entretenimiento y el capitalismo de vigilancia. Tal vez, sólo tal vez, las máquinas realmente puedan ayudar con la policrisis, pero incluso entonces será un viaje largo y extraño sin la gracia de dar un respiro.

Ok, basta. En este artículo he tratado de lidiar con el extrañamiento global jugando con la palabra y los conceptos que la alimentan. Lidiar con la extrañeza puede ayudarnos a aprender a trabajar con transformaciones perturbadoras e incluso aterradoras que abruman nuestra capacidad de modelar o comprender. La extrañeza nos da una vibra con la cual bailar el tango, una tradición imaginal a la que conectarnos, incluso una ética de alteridad rara para orientarnos, de modo que podamos trabajar en cuál realidad importa en medio de la neblina púrpura de la guerra de información de túneles de la realidad que ya ha comenzado. Lo extraño puede ser repugnante y pegajoso, pero conocer sus profundidades proporciona una poderosa y extraña sensación de estabilidad, no muy diferentes de la capacidad de estar bien en presencia de cadáveres, dioses o patologías de todo tipo. Nada humano me es ajeno, y nada alienígena tampoco.

Y es importante recordar que extrañeza es una palabra-mundo fundamentalmente ambivalente, un término de miedo y asombro, una línea de fuga frente a la repetición y las limitaciones de toda predicción, un marcador de interregno, un portal entre mundos. Digo esto aquí no sólo para recordarles (y especialmente a menudo soy pesimista) que algunas cosas maravillosas pueden surgir y surgirán de estas tecnologías. Quiero decir, resolver el problema del plegamiento de proteínas es fantástico. Pero ese no es el punto aquí. Más importante aún, quiero invocar la rareza que permanece más allá del cálculo, la comunidad secreta que, paradójicamente, puede volverse más visible y más maravillosa en el momento mismo de su última sumisión a la agitación del cómputo infinito. En otras palabras, a medida que las máquinas colonizan al ser humano, puede filtrarse un misterio más fundamental: la extrañeza de que los seres sintientes son y siempre han sido: grietas luminosas en un orden de cosas que ya no están ordenadas.

Erik Davis, 11 de abril de 2023

Publicado con la amable autorización del autor y la no menos amable traducción, asistida por IA, de Sirius Mazzu.

PUBLICACIÓN ORIGINAL: Burning Shore (altamente recomendable!)